Yapay Zeka Devrimi ve Güvenlik: Eski Kuralların Yıkıldığı Yeni Dönem

Yapay zeka (AI), bugün artık kurumsal stratejilerin "gelecek" başlığı altından çıkıp, operasyonlarımızın en derin kılcal damarlarına sızmış durumdadır. "AI Is Everywhere" (Yapay Zeka Her Yerde) bir slogandan ziyade, teknik bir realiteyi ifade ediyor. Geliştirici asistanlarından (Developer Assistants) karmaşık veri analitiği motorlarına, müşteri hizmetleri botlarından kurumsal SaaS AI araçlarına kadar her noktada yapay zeka ajanları otonom kararlar alıyor. Ancak bu görünmez devrim, verimlilik vaat ederken aynı zamanda kurumsal savunma hatlarımızı kökten değiştirmemiz gerektiğini fısıldıyor. Siber güvenlikte artık "hazırlıklı olmak" bir seçenek değil; bu yeni akışkan dünyada hayatta kalmanın tek yoludur.

1. "Kale" Modeli Resmen Çöktü: Geleneksel Güvenlik Neden Yetmiyor?

On yıllardır siber güvenliğin temelini oluşturan "Kale" doktrini —yani içerisinin güvenli, dışarısının ise mutlak tehdit olduğu çevre odaklı yaklaşım— yapay zekanın sıvılaşmış veri akışı karşısında tamamen buharlaşmıştır. Geleneksel güvenlik, statik bir yapıda kullanıcı ve cihaz merkezli duvarlar örerken; Modern AI Ekosistemi sürekli akışta, dağıtık ve dinamik bir yapı arz eder.

Bugün AI ajanları, ağ sınırlarını (perimeter) tanımadan multi-cloud yapılar ve API tabanlı entegrasyonlar üzerinden veri transferi yapıyor. Bu yeni ekosistemde "fiziksel" veya "network" tabanlı sınırlar anlamını yitirmiştir. Artık kimlik (identity) yeni sınırdır ve bu sınır, sadece insanların değil, birbirleriyle konuşan otonom yapay zeka ajanlarının niyetlerini de doğrulamak zorundadır.

2. Shadow AI: Kurumunuzun Bilmediği Tehdit Yüzeyi

Kurumların en büyük yanılgısı, güvenliği sadece onaylı AI projeleri üzerinden kurgulamaktır. Oysa "Shadow AI", çalışanların kontrolsüz bir şekilde kullandığı SaaS araçları üzerinden kurumun denetimi dışında devasa bir saldırı yüzeyi oluşturmaktadır.

Bu durum, geleneksel veri sızıntılarından farklı olarak, fark edilmeyen bir "veri ve API ağı" (mesh) yaratır. Çalışanların kurumsal verileri kontrolsüz platformlara yüklemesi sadece bir sızıntı değil; gizli API'lar üzerinden kurulan yetkisiz bağlantılarla API Abuse (API Suistimali) riskini en üst seviyeye taşır. Görünürlüğün olmadığı yerde güvenlikten bahsetmek imkansızdır.

3. Prompt Injection ve Model Manipülasyonu: Mantık Hedefte

Yapay zeka sistemlerine yönelik saldırılar, geleneksel malware mantığından temelden ayrışır. Geleneksel saldırılar kodun içindeki zafiyetleri hedeflerken, AI odaklı saldırılar mantık ve veri yorumlama zafiyetlerini hedefler.

-

Prompt Injection: Modelin komut setini manipüle ederek, savunma mekanizmalarını mantıksal düzeyde devre dışı bırakma.

-

Model Manipülasyonu: Yapay zekanın öğrenme süreçlerini veya veri setlerini bozarak yanlış kararlar almasını sağlama.

-

Deepfake ve AI-Powered Phishing: İnsan sesini ve görüntüsünü taklit eden, tespit edilmesi neredeyse imkansız olan sosyal mühendislik saldırıları.

-

AI-Generated Malware: Yapay zeka tarafından sürekli evrilen ve imza tabanlı savunmaları bypass eden otonom zararlı yazılımlar.

-

Credential Theft & AI Supply Chain Risks: Yapay zeka tedarik zincirindeki otonom ajanların kimlik bilgilerinin çalınması.

"AI dönüşümünü durdurmak mümkün değil. Ancak doğru güvenlik yaklaşımıyla güvenli hale getirmek mümkün."

4. AI Güvenliği Tek Bir Ürün Değil, Çok Katmanlı Bir Mimaridir

Yapay zekayı korumak, birbirine entegre olmayan dağınık ürünlerle değil, bir Unified Security Platform (Bütünleşik Güvenlik Platformu) yaklaşımıyla mümkündür. Stratejik bir mimaride bulunması gereken 5 temel sütun şunlardır:

-

Görünürlük ve Keşif: Kurum içindeki tüm (onaylı veya gölge) AI kullanımını anlık olarak haritalandırmak.

-

Veri Koruma: DLP ve ileri düzey şifreleme ile AI modellerine beslenen verinin güvenliğini sağlamak.

-

Güvenli Erişim (Zero Trust): Sadece "kimin" girdiğine değil, AI ajanlarının "ne amaçla" veri talep ettiğine (intent verification) odaklanan sürekli doğrulama.

-

Tehdit Önleme: AI tarafından üretilen saldırıları yine AI tabanlı proaktif savunma araçlarıyla durdurmak.

-

Yönetişim ve Uyum: Politika yönetimi ve regülasyonlara (ISO 27001, KVKK vb.) tam uyum.

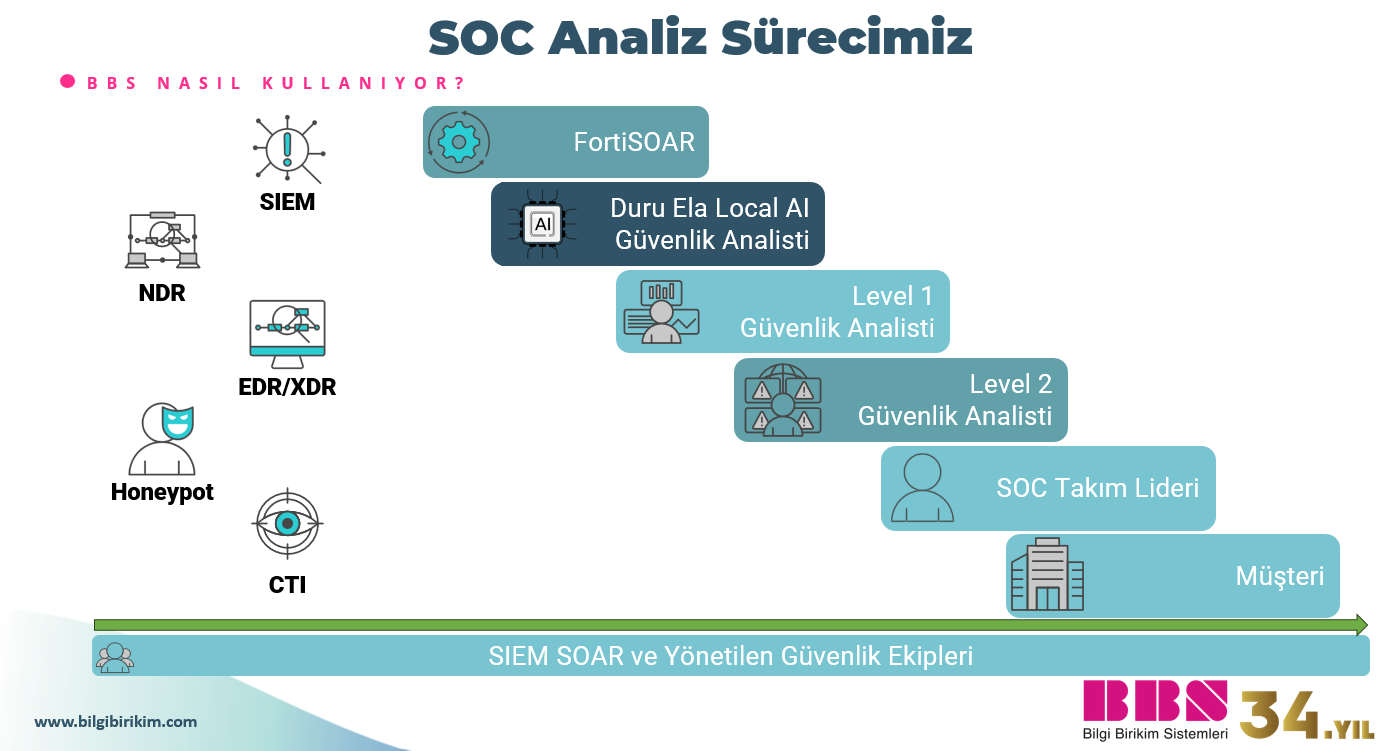

5. Savunmanın Yeni Gücü: AI Destekli SOC ve Otonom Müdahale

Yapay zeka, saldırganların elinde bir silah olduğu kadar, savunma tarafında da en güçlü müttefikimizdir. Modern Güvenlik Operasyon Merkezleri (SOC), saniyeler içinde tehdit tespiti yapabilmek için otonom süreçleri devreye almaktadır.

Bu noktada Bilgi Birikim olarak sunduğumuz süreçte

Duru Ela Local AI, kritik bir rol üstlenmektedir.

Level 1 Güvenlik Analisti olarak konumlandırdığımız Duru Ela, binlerce alarmı saniyeler içinde analiz ederek yanlış alarmları (false positives) filtreler ve gerçek tehditleri ilişkilendirerek insan uzmanların önüne getirir. FortiSOAR entegrasyonu sayesinde bu analizler otonom müdahaleye dönüşür; böylece saldırıların yayılması daha başlamadan durdurulur.

Sonuç: Dönüşüm Kaçınılmaz, Hazırlık Şart

Yapay zekâ bir trend değil, iş yapış biçimlerini yeniden tanımlayan yeni bir işletim modelidir. Bilgi Birikim Sistemleri olarak, 1992'den bu yana edindiğimiz derin tecrübeyi;

-

T.C. Sanayi ve Teknoloji Bakanlığı Kamu Bilişim Yetki Belgesi,

-

TSE A Tipi Sızma Testi Sertifikası,

-

ISO/IEC 27001:2022

-

ISO 20000-1:2018

gibi prestijli yetkinliklerle birleştiriyoruz.

Uzman kadromuzla, kurumları dağınık güvenlik ürünlerinin oluşturduğu karmaşadan uzaklaştırarak, entegre ve platform tabanlı modern güvenlik mimarilerine taşıyoruz.

Kurumunuzda yapay zekâ kullanımı her geçen gün artarken, güvenlik stratejiniz hâlâ dünün “kale duvarı” yaklaşımına mı dayanıyor; yoksa yarının dinamik ve akışkan dijital yapısına hazır mı?

Engin Şeref

Engin Şeref

İş Geliştirme Müdürü - Bilgi Güvenliği